Dans le principe je comprends, je bosse déjà 8h par jour sur ce genre de problématique, mais c’est aussi pour ça que je veux un truc qui ressemble “même de loin” à ce que je vais trouver chez mes clients.

Ma base c’est forcément ESXi, maintenant à moi de trouver comment faire pour avoir un “NAS-like” sans claquer 600€

Le SHR de Synology fonctionne justement sur mdadm et LVM2. Donc, tu peux le faire à la main. Casse pied à mettre en place, mais identique. Synology n’a pas du tout réinventé la roue, juste pris de l’existant et encapsulé dans une commande propre à eu afin que cela soit transparent.

J’avoue, j’ai un coté conservateur et les raids des constructeurs de NAS (SHR, Xraid, etc.) ne sont pas ma tasse de thé.

| 250GB | | 2TB | | 2TB |

|---------------| |----------------| |----------------|

| 125GB | 125GB | | 1.87TB | 125GB | | 1.87TB | 125GB |

| sda1 | sda2 | | sdb1 | sdb2 | | sdc1 | sdc2 |

| | | | | |

| | | | | |

|-------|-----------|-------| | |

| 0 | | |

|----0------|--------------------|--------|

0 | 1 |

0 |-------1------------|

0 1 2

md0 md1 md2

md0 = 125GB + 125GB

md1 = 125GB + 125GB

md2 = 1875GB + 1875GB

= 2125GB Spanned RAID1 storage

Revenons sur ton installation NAS et virtualisation.

VMM c’est du Windows pour gérer Hyper-v, donc tu n’est pas fermé a d’autre solution pour le coté hyperviseur ?

Si c’est le cas, regarde le projet Ovirt de Red-Hat qui est super bien foutu.

Tu veux du raid logiciel ou hardware ?

Car en logiciel, je ne vois rien de bien sorcier. Car tu peux récupérer sans aucun problème le raid SHR sous linux et l’utiliser. C’est la procédure de Synology, je n’invente rien.

apt inslall -y mdadm lvm2

Et puis pour monter le ou les volumes

mdadm -Asf && vgchange -ay

Combien de port SATA/SAS as tu besoin ?

Raid matériel ou logiciel ?

Si matériel, effectivement il te faudra une bonne RAID avec cache et batterie et dans ce cas tu repars de zéro.

Si logiciel pas besoin d’une carte de ouf. Car tout va être gérer par l’OS et une carte pro qui tague les disques durs pour son fonctionnement, ca peut être assez problématique. D’ou l’utilité d’avoir une carte SATA/SAS basique ou qui fonctionne aussi en HBA.

Je l’ai vécu avec du FreeBSD. Je devais monter du ZFS et tout les disques du serveur de réforme qui était en RAID via la carte étaient taguer. Et un tag de geom qui est utilisé justement par BSD. Au taf, je me suis un peu arracher les cheveux durant 30 minutes.

Si tu désire avoir un serveur dédié au stockage et un autre à la virtualisation, c’est la méthode la plus simple. Car cela évite d’avoir un hyperviseur de stockage.

Ta carte mère MB B75MA-E33 dispose de 4 ports SATA qui peuvent parfaitement accueillir les anciens disques dur de ton Synology.

L’os, devra être sur une clef SATA ou alors un petit disques dur/SSD de récupération su une carte SATA 2 ports classique. Et tu pourras même envisager la possibilité de faire du RAID1 pour l’OS

Si tu veux une carte HBA pour avoir énormément de port. Tu en trouve à 60€ sur ebay pour 8 port SATA/SAS.

Si tu n’as pas peur et tu es patient. Une carte RAID LSI avec batterie et RAM pour 35€.

Au final du désire avoir un lab de travail avec un coté perso dessus.

Une de mes machines de LAB à domicile est un dual Xeon E5560, 48Go de RAM ECC reg reformé de marque fujitsu.

Dessus j’ai une ubuntu avec mon vmware workstation ou je virtualise vSphere comme Hyper-v comme le stockage. Pas de besoin de raid, juste d’espace et d’un bon SSD qui encaisse les io.

Le réseau, j’ai du GNS3 tout comme Open vSwitch.

Et pour gérer le stockage, pas de prise de tête, j’ai des montages NFS et iSCSI sur la Ubuntu affin d’y connecter les hyperviseurs. Au pire, si c’est pour windows, je me monte un hypersieur de stokage.

J’ai pas spécialement d’affinité avec SHR mais comme c’est très bien intégré sur les Synology c’est ma « base » de comparaison. Disons que je voudrais trouver l’équivalent gratuit même si c’est plus complexe à monter au début, du moment que j’ai la souplesse et les retours en cas de défaut, ça me va.

Pour en revenir à mdadm et LVM2 c’est du full linux, ça implique une 3ème VM dans ma config juste pour ça.

C’est envisageable mais il va falloir que je me remette sérieusement à Linux dans ce cas…

VMM faisait référence à Virtual Machine Manager de Synology (ils ont eu la fausse bonne idée de prendre le même acronyme que la techno dont tu me parle sous Windows) donc effectivement je changerais d’hyperviseur mais pas pour Hyper-V, pour un truc plus « user-friendly » dans l’optique ou je met le max de pognon pour le moins de prise de tête. (et au passage ça me permet de tester si la solution est viable pour certains clients)

Peu importe du moment que j’ai les mêmes avantages que le SHR sans trop de perte de performance.

Comme dit au dessus, ça implique de monter une VM Linux rien que pour ça et je perds quand même la « facilité » d’utilisation du Synology.

Si je veux vraiment rassembler tous mes disques il me faudrait 6 ports SATA : SSD et HDD du MBP + 4 HDD du Syno.

Pour pouvoir faire du RDM il me faut une carte compatible ESXi donc une carte RAID (même si au final le RAID ne sera pas géré par la carte en elle même)

Je pensais mettre ESXi + VM sur le SSD, backup de l’ensemble sur le HDD, et toutes les datas « réelles » sur les 4 disques en RAID.

Pour l’instant vu que je compte recycler le maximum de truc je me contenterais des 4+2 disques donc pas besoin de beaucoup de ports. Par contre ton lien c’est du LSI t’es sûr ? C’est pas limité en compatibilité pour des serveurs IBM ?

C’est un peu l’idée même si la partie « Lab » me servira quand même réellement et n’aura pas vocation à être reset toutes les 2 semaines. Le but initial de la réflexion c’est quand même de rassembler du matériel, de gagner en puissance, voir en souplesse et de diminuer la consommation électrique aussi tant qu’a faire.

Je pense que c’est la partie « hyperviseur de stockage » qui est encore assez flou de mon coté.

Synology utilise Linux pour son OS et son SHR. C’est juste une série de script qui utilisent mdadm & LVM2 pour que tous cela soient transparents en GUI et CLI (je fais simple).

Au niveau RAID logiciel ou hardware qui offrent un système simple et équivalent au SHR. Je n’en connais pas.

Dans mon taf, je n’ai jamais utilisé de Synology. Juste deux fois du Qnap. Après ce sont des baies SAN qui ont un fonctionnement différent.

Soient tu décides de refaire de l’administration systèmes sous Linux pour gérer de façon équivalente le SHR ou alors tu parts sur quelques choses de simple, efficace et éprouvé (souvent la meilleure des solutions).

Ton projet est intéressant, mais j’ai des doutes sur tes compétences techniques pour gérer un serveur vSphere, systèmes, stockage et réseaux.

Si tu comptes être enfermé dans l’écosystème de VMware. Tu as vSphere + Vsan (mais uniquement sur du stockage flash)

Pour moi, ton projet ne peut fonctionner que avec une excellente carte RAID pour ta partie DATA. Car sinon tu seras effectivement obligé de monter une VM pour gérer le stockage en mode HBA. ainsi que les partages NFS/Samba/FTP/iSCSI. Vsphere ne sais pas être un serveur de stockage ![]()

Un hyperviseur de stokage, c’est ce que l’on nome aussi software defined storage.

Un des exemples est vSAN de chez VMware, ou DataCore ou encore windows server 2016 ou Swift ou Cinder.

Oui c’est du LSI. Et tu ^peux même la flasher avec un autre firmware LSI pour replacer celui d’IBM.

Dell, HP, Fujitsu, Intel, etc. utilisent très souvent aussi du LSI qui appartient maintenant à Broadcom.

Même dans le monde professionnel il y a des fournisseurs pour les marques qui font du rebadging ![]()

Je sais bien tout ça, c’est aussi le prix qu’on paye quand on achète un Synology, l’intégration de fonction « avancés » accessible à l’utilisateur un tout petit peu avertis. D’où mon avis de faire l’équivalent, mais avec une couche de virtualisation.

Chez mon client principal j’ai monté un cluster vSphere de serveurs HP avec deux synology SHA en iSCSI pour le stockage des VMs pour une 100aine de poste clients donc même si je suis pas encore expert dans le domaine je sais de quoi on parle quand même et tant que ça reste chez VMware.

Un vSAN peut se monter sans être forcément en flash même si pour avoir de bonnes perfs c’est conseillé d’être full flash et 10Gb. Mais pour moi un vSAN ne s’applique que pour une connexion distante entre l’host et le stockage, pas quand le stockage est interne à l’host.

Tu me rassure

Je vais prendre le projet d’un autre angle. Sans ce prendre la tête.

As tu besoin d’un hyperviseur et un nas fonctionnant h24 et 7/7 ?

- les 2 oui : une seule machine est un choix judicieux.

- juste le nas : dans ce cas une machine dédié au nas. Si récupération de matériel, downclocker en undervolting du cpu.

- aucun des deux n’ont besoin d’être disponible en permanence. Au choix l’une des solutions précédentes.

Il me semble que plus haut tu as parlé des storage space sous Windows server. Cela peut être une bonne alternative dans le cas du h24 et 7/7. Faudra que tu t’assure dans vSpere que les disques que tu vas utiliser sont régler en mode hba.

Oui c’est plus sage, ça reste un « délire de hobby » pas un projet Pro que je doit boucler dans 3 jours ![]()

Dans l’absolus non, mais vu que je cherche « d’une certaine manière » à être dans une situation que je retrouverais éventuellement chez des clients autant avoir les trucs qui tournent tout le temps.

Dans le principe je voulais faire la partie NAS uniquement pour la gestion du partage, mais gérer tout le reste avec le windows server. Du genre monter un vrai domaine (+ DHCP / DNS / VPN) avec peut être deux DC, faire des sessions authentifiées sur le domaine pour les 2 macs et les 2 pcs de l’appart, gérer les droits d’accès des partages, et même pourquoi pas balancer des policies pour virer les réglages de base pourris de chez Microsoft ![]()

Ton mode HBA c’est ce qu’il appel Raw Device Mapping chez VMware ? Si c’est bien ça il me faudra quand même une carte « SATA/SAS » compatible ESXi pour monter les disques en un genre de « passthrough »

http://www.flexraid.com/2014/02/07/storage-deployment-vmware-esxi-iommuvt-d-vs-physical-rdm-vs-virtual-rdm-vs-vmdk/

Ah ce thread me rappelle mes débuts professionnels avec les commandes metastat sous Solaris

#nostalgie

Tu es motivé !

Ca mefait trop penser a mon taf ![]()

Le HBA c’est l’accès en direct des disques durs ou SSD sans passer par la couche de gestion de la carte RAID. Et ensuite dans vSphere, c’est bien le mode passthrough affin que la VM puisse gerer en directe les disques durs ou SSD.

Le passthrough s’utilise aussi avec des cartes réseaux, bus PCI-e, GPU, USB, etc.

Parfois il faut du matériel spécifique, ce qui n’est pas ton cas.

Tu peux parfaitement sortir des recommandations de VMware vu que ton installation n’a aucun support chez eux ![]()

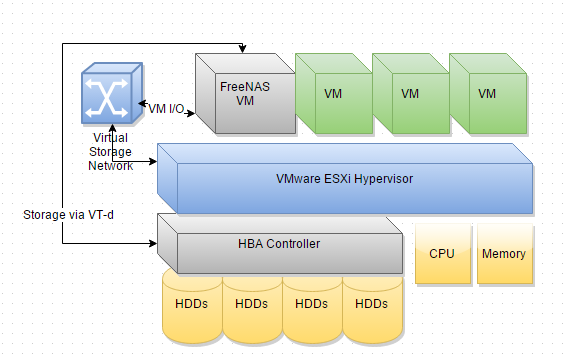

Je ressort le diagramme précédemment mis dans une réponse.

Tu remplace la VM FreeNAS par Windows Server

C’est aussi en partie le miens ![]()

Je vais monter une maquette ce soir/weekend avec une clé usb pour esxi, un petit disque pour les VMs et 3 gros disque pour tester le HBA/RDM via FreeNAS et/ou Windows pour voir si ça colle à mon besoin… Et surtout si ESXi accepte de le faire avec le contrôleur SATA intégré à la MB.

FreeNAS, je te déconseille si tu n’as pas au moins 16Go de RAM. Tu vas ressentir des ralentissements surtout si tu utilises le iSCSI.

FreeNAS possède un hyperviseur natif : bhyve.

Tes contrôleurs SATA seront parfaitement reconnu. Désactive juste le pseudo rais dans le bios.

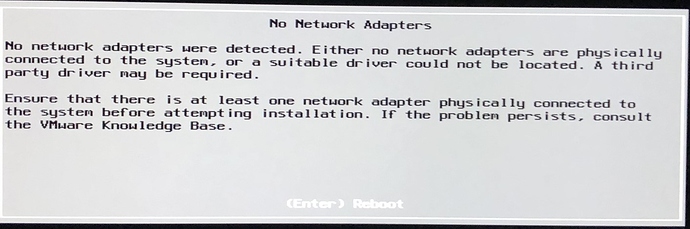

C’est plié l’interface réseau n’est pas compatible avec ESXi, j’ai essayé avec la 6.0, 6.5 et 6.7, le résultat est le même.

Je vais regarder demain si j’ai d’autre MB de dispo… Je dois pouvoir récupérer une H67MA-E35 mais c’est le même chipset realtek pour le réseau donc j’imagine que je vais avoir le même soucis.

J’edit au fur et à mesure… c’est normal le chipset Realtek 8111E n’est pas orienté “pro”. Il faut que j’incorpore les drivers dans mon installation. (rellloouu)

D’ou l’utilité de prendre des carte mère avec un contrôleur Intel pour le réseau.

Au pire, ebay pour une dual giga

Intel ou broadcom, le reste, ça passe pas dans mon souvenir. J’avais du acheter une carte pci-express à l’époque, ça m’avait coûté 15 balles… Ebay est ton ami.

Finalement c’est passé en ajoutant le drivers qui va bien sur l’installation ESXi. Je tente le montage de la config de test ce weekend.

Alors après une gentille galère de carte mère/proc (le BIOS n’était pas à jour, et le seul proc qui savait faire de la virtu avancé était pas reconnu. Après installation de Win7 et mise à jour du BIOS, hooo bonheur ça boot avec le bon proc) j’ai monté ma config “draft” et pour l’instant c’est fonctionnel.

J’ai opté pour le plus “simple” au niveau de la gestion du SHR, j’ai virtualisé Xpenology avec les disques “RAID” en RDM. Résultat identique à ce que j’ai sur un vrai Synology, moins les informations SMART.

J’ai plus qu’a trouvé un moyen de remonter le SMART d’une manière ou d’un autre (au pire même un script ESXi qui m’envois un mail ça me suffirais)

Vu que ma “maquette” est fonctionnelle, je me repenche sur le boitier qui va accueillir tout ça.

Pour le moment c’est le Lian Li M25 qui me parait le plus complet. Par contre quelqu’un à déjà acheté sur ce site Overclockers UK ?

J’ai fais un petit tableau comparatif des différents modèles micro-atx que j’ai croisé :

| Marque | Modèle | Largeur | Hauteur | Profondeur | Baies 3,5 | Baies 2,5 | Baies 5,25 |

|---|---|---|---|---|---|---|---|

| SilverStone | Sugo SG11 | 270 | 212 | 393 | 3 | 9 | 1 |

| SilverStone | Grandia GD06 | 440 | 150 | 340 | 4 | 1 | 1 |

| Coolermaster | HAF XB Evo | 442 | 330 | 423 | 4 | 0 | 2 |

| Fractal Design | Define Mini | 210 | 395 | 490 | 6 | 2 | 1 |

| Lian Li | PC M25 | 199 | 322 | 441 | 5 hotswap | 0 | 0 |

Finalement j’ai commandé le Grandia 06 pour sa pronfondeur réduite.

Au passage personne n’aurait deux barrettes de ddr3 8Go à vendre ?

Super ton tableau.

Petite photo une fois que tout est en place